No, no voy a poner faltas de ortografía para demostrar que soy humano

El artículo de Jordi Pérez Colomé en El País, «Las erratas como símbolo de prestigio: cómo escribir para que no parezca IA«, me ha dejado una sensación entre el cansancio, la irritación y la tristeza. La idea de que, en plena explosión de la inteligencia artificial generativa, algunos empiecen a introducir erratas deliberadamente para que sus textos parezcan «más humanos» es una de esas distopías absurdas que, precisamente por absurdas, terminan describiendo muy bien una época.

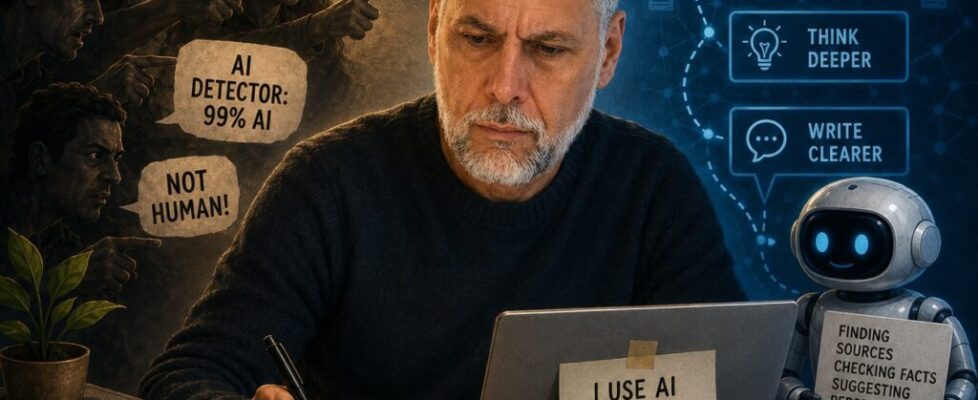

Vivimos instalados en una sospecha permanente. Ya no se lee un texto para preguntarse si dice algo interesante, si está bien argumentado, si aporta algo o si invita a pensar. Se lee, demasiadas veces, como quien pasa un detector de metales: buscando la prueba, el rastro, el supuesto tic, la señal que permita levantar el dedo y decir: «esto lo ha escrito una inteligencia artificial». Es la nueva policía del estilo, una inquisición de andar por casa armada con intuiciones bastante pobres, detectores que no funcionan y una curiosa superioridad moral.

No hay semana en la que no reciba un mensaje, un comentario o una insinuación acusándome de escribir con inteligencia artificial. Y la verdad es que empieza a cansar. Mucho. No porque me moleste que alguien piense que uso inteligencia artificial: la uso, por supuesto que la uso. Me molestan la simpleza del razonamiento, la acusación barata, la idea de que cualquier texto bien documentado, corregido, estructurado o con enlaces adecuados deba ser sospechoso. Me molesta esa pulsión de convertir una herramienta en una prueba de culpabilidad.

Llevo escribiendo más de un artículo diario desde 2003. Eso son casi veinte años antes de que ChatGPT apareciese en noviembre de 2022. Veinte años escribiendo, documentando, enlazando, argumentando, equivocándome, rectificando, aprendiendo y publicando. Francamente, creo que eso debería concederme algo de crédito. No mucho, si no quieres. Pero al menos el suficiente como para no tener que ensuciar deliberadamente mis textos con faltas de ortografía para demostrar que sigo siendo una persona.

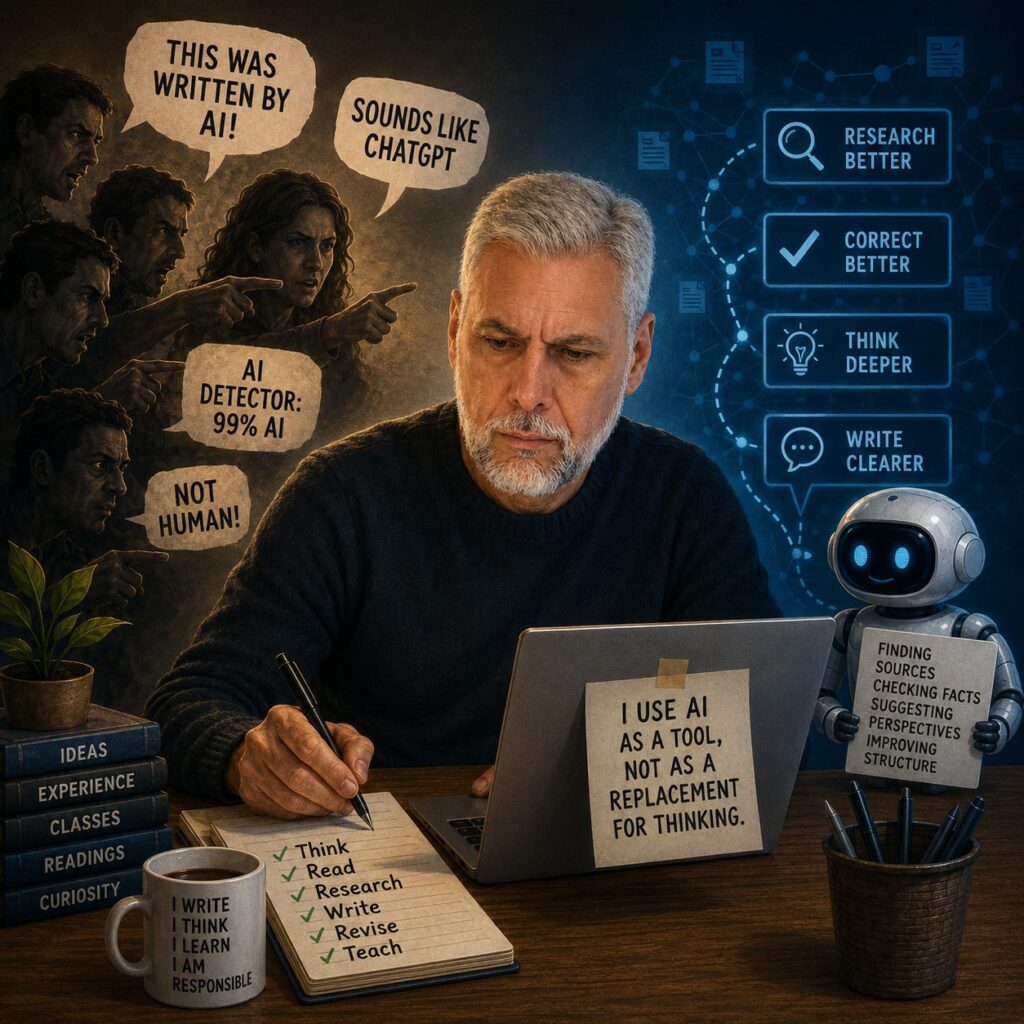

Porque no, no voy a hacerlo. No pienso introducir erratas, torpezas o descuidos calculados para parecer «auténtico». No pienso degradar mi escritura para adaptarme a la paranoia de quienes confunden imperfección con humanidad. La humanidad de un texto no está en una tilde que falta ni en una coma mal puesta. Está en la intención, en la trayectoria, en la capacidad de construir una mirada, en la responsabilidad de sostener una idea y en la posibilidad de responder por ella.

Sí, uso inteligencia artificial, y mucho, pero no para escribir. La uso para documentarme mejor, para encontrar fuentes que antes me habría costado más tiempo localizar, para que agentes configurados por mí y bajo mis instrucciones busquen artículos que puedan ampliar o contrastar lo que estoy pensando. La uso para revisar ortografía y gramática. La uso, en ocasiones, para que otro agente, entrenado con mis propios artículos, me sugiera pequeños ajustes de estructura o me señale puntos débiles, basándose en la comparación con mis artículos más exitosos o con más lecturas. A veces, incluso, al terminar un texto, se lo copio a un agente que lo critica y me dice qué ángulos no he considerado. Después leo esa crítica y, si me parece pertinente, escribo un párrafo adicional, matizo una idea o refuerzo un argumento. Yo. Con estos deditos.

¿Y qué? Eso no convierte el artículo en «AI slop«. Eso no significa que el texto lo haya escrito una máquina. Significa que escribo en 2026, no en 1996. Significa que utilizo las herramientas disponibles para hacer mejor mi trabajo, exactamente igual que en su momento utilicé buscadores, gestores de referencias, correctores ortográficos, bases de datos académicas, lectores RSS o traductores automáticos. La diferencia es de potencia, no de naturaleza. Y quien no entienda eso, en realidad no está defendiendo la escritura humana: está defendiendo una visión romántica, artesanal y profundamente equivocada del trabajo intelectual.

El problema no es usar inteligencia artificial. El problema es delegar el pensamiento. El problema es entregar a una máquina la responsabilidad de decidir qué quieres decir, por qué lo quieres decir y desde dónde lo dices. Yo no escribo para llenar una página. Escribo para aprender, para ordenar ideas, para pensar, para después poder explicar esas ideas en clase o en una conferencia. Si una inteligencia artificial escribiese por mí, yo no habría internalizado nada. No podría defender el texto, no podría discutirlo, no podría usarlo como parte de mi proceso docente. Sería una impostura inútil.

Por eso la distinción relevante no es «con inteligencia artificial» o «sin inteligencia artificial». Esa distinción es infantil. La pregunta relevante es otra: ¿quién piensa? ¿Quién decide? ¿Quién asume la responsabilidad intelectual del texto? ¿Quién puede explicar por qué está ahí cada argumento, cada enlace, cada ejemplo y cada conclusión? Esa es la conversación que deberíamos estar teniendo, no esta especie de concurso ridículo para ver quién logra sonar lo bastante imperfecto como para ser aceptado como humano.

Además, la propia industria y la academia saben perfectamente que los detectores de texto generado por inteligencia artificial no son una solución fiable. OpenAI reconoce en su guía para educadores

que esos detectores no son suficientemente fiables y que pueden etiquetar texto humano como generado por máquinas. MIT Sloan lo dice de manera aún más directa en un recurso titulado «AI detectors don’t work«. Estudios como el publicado en Patterns sobre el sesgo de los detectores contra escritores no nativos en inglés muestran, además, que esas herramientas pueden ser injustas y discriminatorias: penalizan estilos más simples o más estructurados, y convierten en sospechosas a personas que simplemente escriben de manera clara.

Turnitin, una de las compañías más utilizadas en entornos educativos, advierte que sus modelos no deberían usarse como única base para tomar medidas contra un estudiante, algo que recoge también el ABA Journal. UNESCO, en su guía sobre inteligencia artificial generativa en educación e investigación, insiste en un enfoque centrado en las personas, en la transparencia y en el uso significativo de estas herramientas. En otras palabras: las instituciones serias no dicen «prohibamos, sospechemos y acusemos». Dicen «aprendamos a usar, a declarar, a evaluar procesos y a formar criterio».

Pero la cultura popular va por otro lado. Va por el camino fácil de la sospecha. Por el «esto suena a ChatGPT», porque lo digo yo. O por el detector milagroso. O por la búsqueda de tics estilísticos. O por la idea absurda de que un guion largo, una estructura ordenada o una conclusión redonda son ya indicios de culpabilidad. O ahora, según parece, por la reivindicación de la errata como certificado de humanidad. Hemos llegado al punto en que escribir bien puede ser sospechoso y escribir mal puede ser una estrategia reputacional. No se me ocurre mejor descripción de una sociedad confundida.

Lo más irónico es que muchos de quienes acusan a otros de usar inteligencia artificial lo hacen desde una ignorancia bastante notable sobre cómo funciona realmente la escritura. Escribir nunca ha sido un acto puro, aislado o místico. Escribir es conversar con fuentes, con lecturas previas, con notas, con editores, con correctores, con alumnos, con colegas, con críticas y con uno mismo. La inteligencia artificial se inserta en ese proceso como una herramienta más. Extraordinariamente poderosa, sí, pero no como una sustitución inevitable del autor. Que algunos la usen para sustituirse a sí mismos no significa que todos lo hagamos. Y menos los que más perjudicados podríamos salir si lo hiciéramos.

La autenticidad no está en rechazar las herramientas. Está en no abdicar del criterio. Está en no confundir asistencia con autoría. Está en poder decir: esta idea es mía, esta estructura la he decidido yo, esta fuente la he elegido yo, esta conclusión la sostengo yo. Y está también en aceptar que escribir con herramientas mejores puede producir textos mejores. Más largos, quizá. Más documentados. Más matizados. Más revisados. ¿Desde cuándo eso es un problema?

Me niego a participar en la teatralización de la imperfección. No voy a escribir peor para parecer más humano. Antes tenía más typos, ahora tengo menos porque me los corrige un agente. Antes ilustraba con aburridas ilustraciones de repositorio, ahora ilustro con inteligencia artificial, porque nunca he sido ilustrador ni considero que las ilustraciones sean lo que define mis artículos. Simplemente, me es más cómodo y me gusta más así. Y no, decididamente no voy a dejar faltas para tranquilizar a quienes han decidido que la corrección es sospechosa. No voy a convertir mi escritura en una coartada contra una acusación mal formulada. Si alguien quiere creer que un texto mío lo ha escrito una máquina porque está bien enlazado, porque no tiene faltas o porque incorpora puntos de vista adicionales, que lo crea. El problema no está en mi texto. Está en su incapacidad para entender cómo se trabaja hoy.

La inteligencia artificial obliga a repensar muchas cosas: la enseñanza, la evaluación, la autoría, la transparencia, el aprendizaje, la creatividad y la responsabilidad. Pero repensarlas no significa caer en una histeria permanente ni transformar cada texto en una escena del crimen, ni llegar a la página de un autor como un histérico maleducado gritando «esto es AI slop!!» Significa asumir que las herramientas han cambiado y que, por tanto, también debe cambiar nuestra forma de valorar el trabajo intelectual.

Yo seguiré escribiendo. Seguiré usando inteligencia artificial cuando me ayude a documentarme mejor, a corregir mejor, a contrastar mejor o a pensar mejor. Seguiré siendo yo quien decide qué se publica y qué no. Y seguiré negándome a aceptar que la humanidad de un texto se mida por su descuido.

Porque si hemos llegado al punto en que para parecer humanos tenemos que escribir peor, el problema no lo tiene la inteligencia artificial. Lo tenemos nosotros.