Meta y el final de la coartada

Hay empresas que no caen cuando dejan de ganar dinero, sino cuando dejan de poder explicarse moralmente.

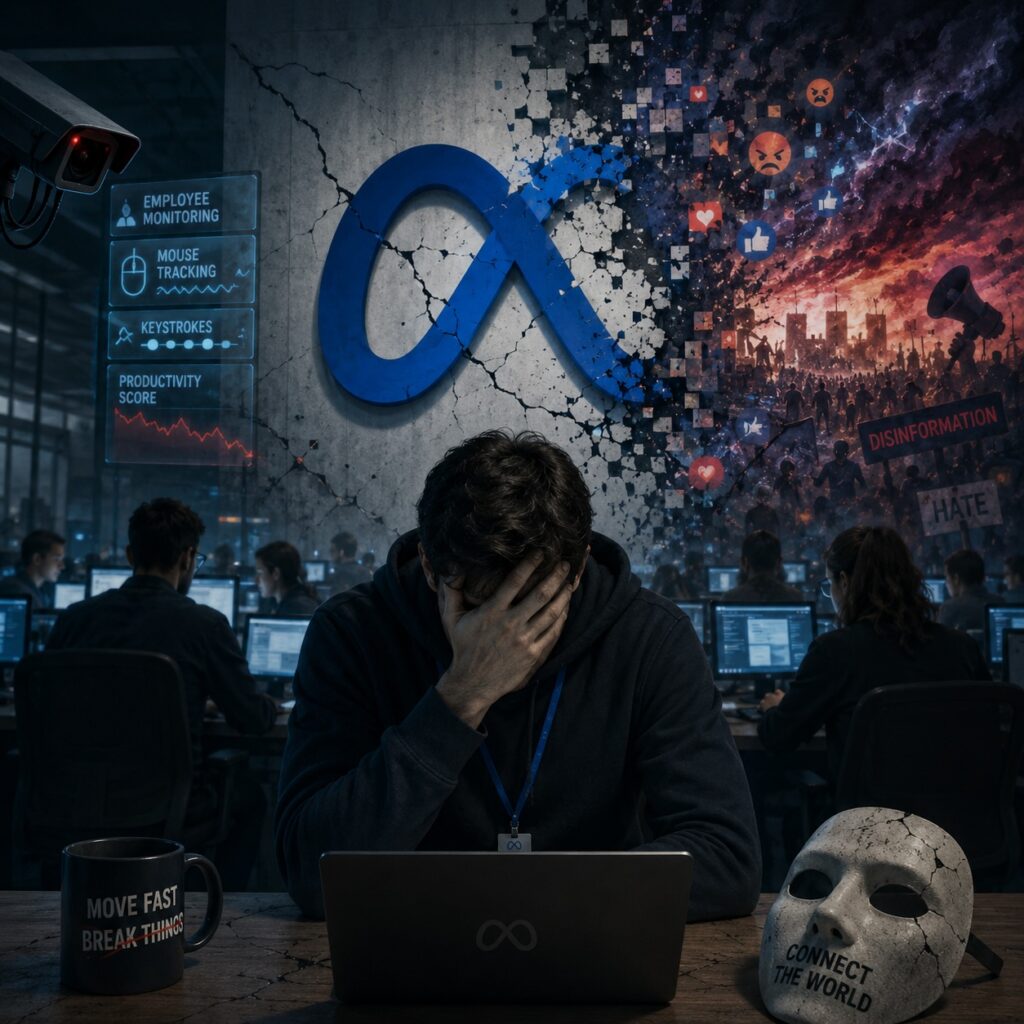

Meta parece estar entrando en esa fase. No porque sus beneficios hayan desaparecido, sino precisamente porque siguen ahí: una compañía con beneficios récord y una moral interna por los suelos, preparando nuevos despidos, con empleados que hablan de miedo, hartazgo, desigualdades salariales demenciales, vigilancia y una sensación creciente de haber perdido toda conexión con la supuesta «misión».

La pregunta incómoda no es si Meta está implosionando financieramente. Obviamente no, o al menos, no todavía. La pregunta interesante es si está implosionando culturalmente. Si sus empleados empiezan a entender que trabajan en una organización que durante años optimizó la adicción, la polarización, la vigilancia, la manipulación emocional y la degradación del discurso público, y que ahora pretende rematar la jugada entrenando sistemas de inteligencia artificial con todo lo que encuentra, incluidos datos de sus propios trabajadores. Debe ser duro saber que trabajas para una organización tan perjudicial para la humanidad.

Durante mucho tiempo, trabajar en Meta fue una forma de comprar indulgencias: salarios altísimos, stock options, campus agradable, prestigio, currículum, impacto. Pero el impacto, cuando se evalúa con un mínimo de objetividad, no era precisamente benigno. Amnistía Internacional demostró que Facebook contribuyeron a amplificar el odio genocida contra los rohinya en Myanmar. La FTC impuso a Facebook una multa histórica de 5.000 millones de dólares por violaciones de privacidad. The Wall Street Journal reveló documentos internos sobre los efectos de Instagram en adolescentes, particularmente sobre las chicas jóvenes. Y ahora, los grandes editores y el escritor Scott Turow acusan a Meta y a Zuckerberg de usar obras pirateadas para entrenar Llama, después de despreciar las posibles vías de licencia.

No, no es el juicio de Nuremberg: no conviene banalizar la historia. Pero sí hay una idea de Nuremberg que sigue siendo válida: el «seguía órdenes» no es una coartada moral cuando uno sabe lo que está haciendo. Y en Meta lo sabían. Lo sabían cuando diseñaban sistemas para maximizar el engagement aunque degradaran la conversación pública. Lo sabían cuando convertían la privacidad en una variable explotable. Lo sabían cuando Instagram afectaba a adolescentes. Lo sabían cuando la plataforma se convertía en infraestructura de propaganda, odio y manipulación. Y lo sabían porque muchos de esos daños estaban documentados, denunciados y discutidos dentro y fuera de la empresa.

La novedad es que ahora la maquinaria empieza a aplicarse hacia dentro. El trabajador de Meta que durante años contribuyó a vigilar, perfilar y explotar a miles de millones de usuarios descubre que también él puede ser vigilado, medido y convertido en dato de entrenamiento. Fast Company lo resume con claridad: la vigilancia laboral plantea un problema ético evidente cuando los empleados no tienen una opción real y sus puestos están en juego.

Ahí aparece la grieta. No es un arrepentimiento puro, ni una conversión ética repentina. Es algo más humano y más incómodo: la comprensión tardía de que el sistema que ayudaste a construir no tenía límites, simplemente todavía no había llegado a ti. Que la cultura de «move fast and break things» nunca fue innovación, sino irresponsabilidad con buen marketing. Que la obsesión por escalar no era neutral. Que «conectar el mundo» acabó significando extraer atención, datos, emociones y creatividad hasta dejarlo todo convertido en maldito inventario publicitario, al precio que fuese.

Julia Angwin ha escrito que Meta ha entrado en su «era zombie»: una compañía que puede seguir viva, rentable y enorme, pero culturalmente muerta, convertida en una versión grotesca de sí misma. Futurism lleva esa idea más lejos y habla directamente de «death spiral»: feeds llenos de basura generada por inteligencia artificial, anuncios, desinformación y decadencia de producto.

Ese es el verdadero problema de Meta: no que vaya a desaparecer mañana, sino que quizá ya ha desaparecido todo aquello que pretendía legitimarla. Facebook dejó de ser una red social para convertirse en una infraestructura de extracción. Instagram dejó de ser una aplicación para compartir imágenes y se convirtió en una máquina de comparación social y frustración. WhatsApp funciona casi como rehén dentro del conglomerado y, frente a la teoría de que las conversaciones están cifradas, somete también a sus incautos usuarios a un espionaje permanente. Y la inteligencia artificial aparece ahora no como una oportunidad de redención, sino como una nueva huida hacia delante, para lograr ser más eficiente haciendo el mal. Las redes sociales han muerto, se han convertido en una basura asquerosa y pringosa. Que aquellos que viven de ellas y se convierten en sus cómplices vayan empezando a enterarse.

¿Cómo puede un empleado enfrentarse a eso? Primero, dejando de mentirse. No trabaja «en tecnología»: trabaja en una asquerosa arquitectura de poder. No «optimiza producto», optimiza comportamiento humano para depredarlo. No «mejora modelos», alimenta sistemas que sustituyen consentimiento por captura, por robo. La primera responsabilidad moral es llamar a las cosas por su nombre.

Después, actuando. Filtrar, protestar, sindicarse, negarse, marcharse, documentar, testificar, ayudar a reguladores, tirar de la manta, apoyar demandas, construir alternativas. No todo el mundo puede permitirse dimitir mañana. Pero seguir cobrando mucho dinero no convierte el silencio en neutralidad: lo convierte en complicidad bien pagada.

Meta no está implosionando porque pierda dinero. Está implosionando porque cada vez resulta más asqueroso y más difícil trabajar allí y seguir creyéndose o pretendiendo ser una buena persona. Y ese, para una compañía que durante años vivió de vender una supuesta narrativa heroica sobre sí misma que jamás fue real, puede ser un problema mucho más grave que un trimestre malo. Cuanto antes muera Meta, mucho mejor para todos.