La máquina de espiar no se arregla cambiando el botón: se apaga prohibiendo su modelo de negocio

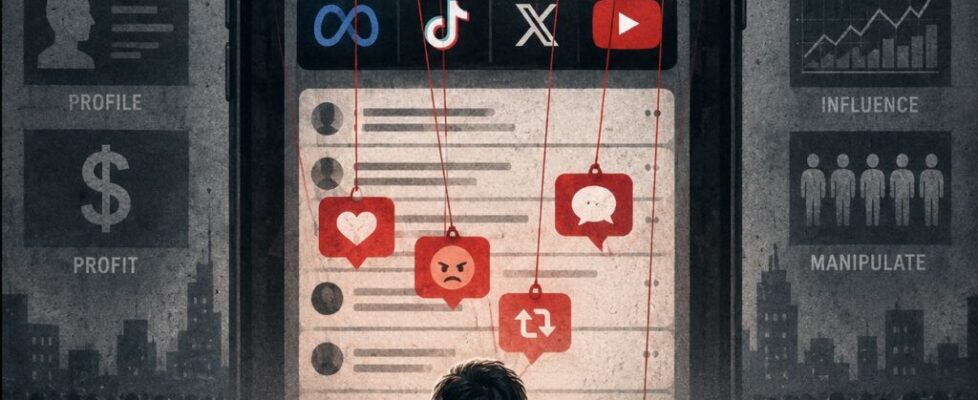

Durante años hemos llamado «redes sociales» a algo que hace ya mucho tiempo dejó de serlo. La palabra red sugería relaciones, comunidades, conversación, vínculos entre personas. Pero lo que tenemos hoy en Facebook, Instagram, TikTok, X o YouTube no es una red social: es una infraestructura industrial de extracción de atención, alimentada por vigilancia masiva, optimizada para mantenernos dentro el mayor tiempo posible y convertir cada gesto, pausa, desplazamiento, reacción o duda en un dato monetizable.

El nuevo trabajo de Maik Larooij y Petter Törnberg, «Can We Fix Social Media?», resulta especialmente incómodo porque hace precisamente la pregunta que muchos reguladores siguen evitando: ¿podemos arreglar las redes sociales con pequeños ajustes de diseño? La respuesta es devastadora: los investigadores simulan una plataforma social con agentes basados en modelos de lenguaje y prueban intervenciones muy razonables: feed cronológico, ocultar métricas, promover contenido de puente, introducir diversidad ideológica. El resultado es que las mejoras son modestas, parciales o incluso contraproducentes: las cámaras de eco, la concentración de atención y la amplificación de voces extremas aparecen de nuevo, como si fueran propiedades estructurales del sistema y no simples errores de diseño.

Esto conecta con la tesis del artículo de Ars Technica sobre el estudio: quizá las redes sociales, tal y como están construidas, simplemente no pueden arreglarse. No porque falten ingenieros brillantes, ni porque los usuarios sean especialmente estúpidos, ni porque no hayamos encontrado aún el algoritmo correcto, sino porque el mecanismo básico está podrido: crecimiento de red, reacción emocional, visibilidad, retroalimentación, polarización y más crecimiento.

Otro artículo de Ars Technica, sobre el supuesto «RIP social media«, apunta a una segunda transformación: la descomposición de la vieja plaza pública digital en espacios más fragmentados, privados, semiprivados, algorítmicos o mediados por inteligencia artificial. Pero que algo se fragmente no significa que se sane. La investigación de Törnberg sobre el uso de redes sociales en Estados Unidos entre 2020 y 2024 muestra un panorama de declive, fragmentación y polarización persistente: los usuarios casuales se retiran, los más polarizados permanecen, y la conversación visible se vuelve más estrecha, más extrema y menos representativa.

Este paper aún en pre-print del propio Törnberg, «Towards a post-social media studies«, lo formula con claridad: estamos entrando en una etapa posterior al paradigma clásico de las redes sociales. El contenido generado por usuarios deja de ser el centro, los grafos sociales pierden peso frente a sistemas de recomendación opacos, la conversación pública se desplaza hacia espacios cerrados o efímeros, y la inteligencia artificial empieza a convertirse no solo en intermediario, sino en medio de comunicación en sí mismo. Dicho de otra manera: el problema ya no es únicamente que las redes sociales funcionen mal, sino que el propio concepto de red social se está disolviendo en una maquinaria aún menos visible, aún menos auditable y aún más personalizada.

Por eso es tan absurdo que el debate político siga girando en torno a parches: prohibir el scroll infinito, poner etiquetas, pedir más moderadores, ocultar los «likes», exigir controles de edad o confiar en que las plataformas diseñen voluntariamente entornos más sanos. Todo eso puede tener algún efecto marginal, pero no toca la raíz. Es como intentar combatir el tabaquismo obligando a cambiar el color del paquete, pero permitiendo a la industria seguir manipulando la nicotina para maximizar la dependencia.

La raíz es el modelo de vigilancia. La Federal Trade Commission estadounidense lo dijo con una claridad poco habitual en un regulador: las grandes plataformas sociales y de vídeo han desplegado una vigilancia masiva de los usuarios para monetizar su información personal, con controles de privacidad insuficientes y protecciones inadecuadas para menores y adolescentes. No hablamos de una metáfora. Hablamos de una industria cuyo incentivo económico fundamental consiste en observar, inferir, clasificar, predecir y manipular.

Ese es el punto que Europa debe asumir de una vez. No se trata de prohibir empresas concretas, ni de castigar nombres propios, ni de construir un ministerio de la verdad, ni de identificar a toda la población para supuestamente proteger a los menores. Se trata de declarar ilegítimo un modelo de negocio basado en la vigilancia sistemática de las personas. El European Data Protection Board ya ha señalado que los modelos de «consentimiento o pago» de las grandes plataformas difícilmente pueden considerarse válidos cuando el consentimiento no es realmente libre. La pregunta, por tanto, no es técnica: es puramente política.

Mientras una plataforma gane más cuanto más tiempo consiga retenernos, y mientras ese tiempo se traduzca en más datos, más perfiles y más segmentación publicitaria, cualquier discurso sobre bienestar digital será propaganda. El algoritmo no está ahí para informarnos mejor, ni para hacernos más felices, ni para fortalecer la democracia. Está ahí para maximizar una función de negocio. Y si la ira, el miedo, la envidia, la indignación o la pertenencia tribal funcionan mejor que la serenidad, la complejidad o el pensamiento crítico, el sistema aprenderá a producir exactamente eso.

Por eso la solución no puede consistir en pedir a Meta, TikTok, X o YouTube que sean «más responsables». Llevamos demasiados años escuchando esa farsa. La solución pasa por prohibir la publicidad comportamental basada en vigilancia, limitar drásticamente la recogida y reutilización de datos personales, imponer interoperabilidad real, exigir auditorías externas de los sistemas de recomendación y obligar a que las plataformas funcionen con modelos que no dependan de conocer al usuario mejor de lo que el usuario se conoce a sí mismo.

Habrá quien diga que eso destruiría internet gratis. No: destruiría una versión profundamente tóxica de internet financiada mediante una violación permanente de la privacidad. También se dijo que prohibir fumar en espacios cerrados destruiría la hostelería, que exigir cinturones de seguridad era paternalismo o que regular los vertidos industriales acabaría con la economía. Lo que ocurre siempre es lo mismo: cuando una industria ha normalizado una externalidad brutal, presenta cualquier intento de limitarla como una amenaza civilizatoria.

Las redes sociales actuales no son una infraestructura neutral contaminada por algunos malos actores. Son máquinas de extracción diseñadas para convertir la vida social en materia prima. Y cuando una máquina está construida para espiar, enganchar y polarizar, no se arregla puliendo la interfaz. Se arregla cambiando la ley que permite que esa máquina exista en esas condiciones.

La cuestión de fondo es muy sencilla: una sociedad democrática no puede delegar su conversación pública en empresas cuyo negocio mejora cuando esa conversación se degrada. Y cuanto antes dejemos de fingir que esto es un problema de diseño, de educación digital o de moderación de contenidos, antes podremos formular la única pregunta que realmente importa: ¿vamos a seguir permitiendo que la vigilancia sea el precio de participar en la vida social digital?